В течение суток после теракта в Новой Зеландии фестиваля документального кино Docudays UA, рассказывает о сложностях работы этих модераторов.

Как модерируют контент на Facebook

В 2013 году на Facebook появилось видео с надругательствами над детьми, и немецкие режиссеры-документалисты Мориц Ризевик и Ханс Блок задались вопросом, как это произошло.

«Обычно такие вещи не встречаются в социальных сетях. Мы начали спрашивать, кто фильтрует интернет, и обнаружили, что тысячи людей ежедневно просматривают то, что мы видим у себя в ленте. Большая часть работы передается на аутсорсинг развивающимся странам, и одним из главных таких мест является Манила на Филиппинах», — рассказали режиссеры в интервью американскому изданию Vice.

Попытавшись связаться с модераторами, Ризевик и Блок узнали, что это очень скрытная отрасль, и сотрудникам попросту не дают высказаться. Помимо строгой политики неразглашения, их аккаунты регулярно проверяют. Если кто-то из них расскажет о своей деятельности, им грозит штраф до 10 тысяч евро. Но все же режиссерам удалось выследить нескольких нынешних и бывших модераторов, заручиться поддержкой юристов и убедить их сняться в фильме.

«Есть два способа передачи контента на Филиппины. Первый — это предварительный фильтр. Алгоритм может анализировать форму, скажем, полового органа, цвет крови или определенный цвет кожи. Таким образом, всякий раз, когда предварительный фильтр анализирует и обнаруживает что-то неуместное, машина отправляет этот контент на Филиппины, а модераторы проверяют, была ли она права. Второй путь — когда пользователи сами отмечают контент как неприемлемый», — объясняет Ризевик особенности работы своих героев.

Когда модератор удаляет нежелательное изображение или видео, оно исчезает из социальной сети повсеместно. Но обнаружив детскую порнографию, «чистильщик» обязан сообщить IP-адрес, местоположение и имя пользователя. Эти данные попадают в частную организацию в США, которая анализирует всю информацию и перенаправляет ее в полицию.

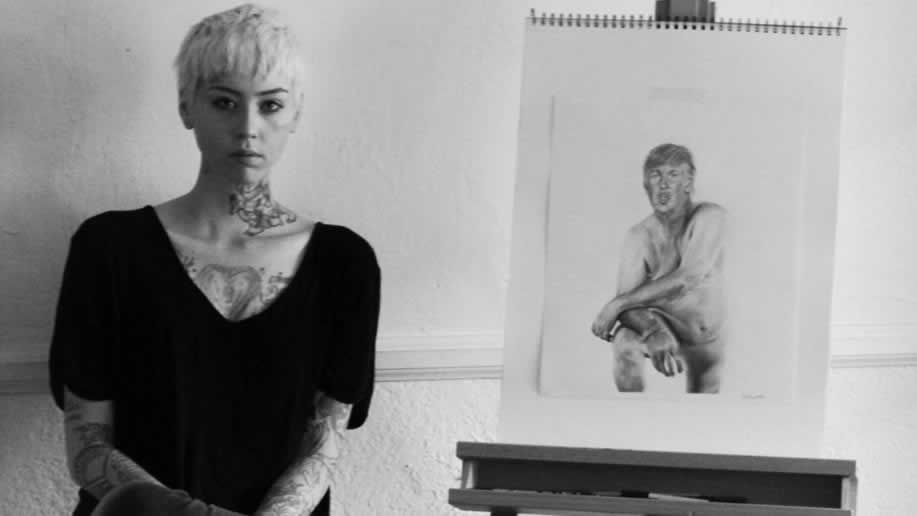

Но если удаление насильственного контента приветствуется обществом, то «оскорбительные» изображения и видео часто становятся предметом спора. Достаточно ли компетентны модераторы, чтобы отличить порнографию от искусства, исторические снимки от сцен жестокости, а политический активизм от экстремизма? Так, в фильме рассказано об удалении картины американской художницы, нарисовавшей голого Дональда Трампа. Модератор понимает, что данное изображение является сатирой, но удаляет его, сославшись на «недопустимость унижения личности американского президента».

«Компании набирают для этой работы людей с улицы. Им дается 3−5 дней на обучение. За это время они должны выучить все рекомендации, поступающие от Facebook, Google, YouTube. Им нужно изучить сотни примеров, запомнить 37 террористических организаций, все их флаги, униформу, слоганы, — объясняет Ризевик. — Другой ужасный факт заключается в том, что у работников есть только несколько секунд, чтобы принять решение. Чтобы выполнить норму в 25 000 изображений в день, у них есть по 3−5 секунд на каждое. Вы не можете проанализировать текст изображения или полностью убедиться в правильности своего решения, если вам нужно просмотреть столько контента».

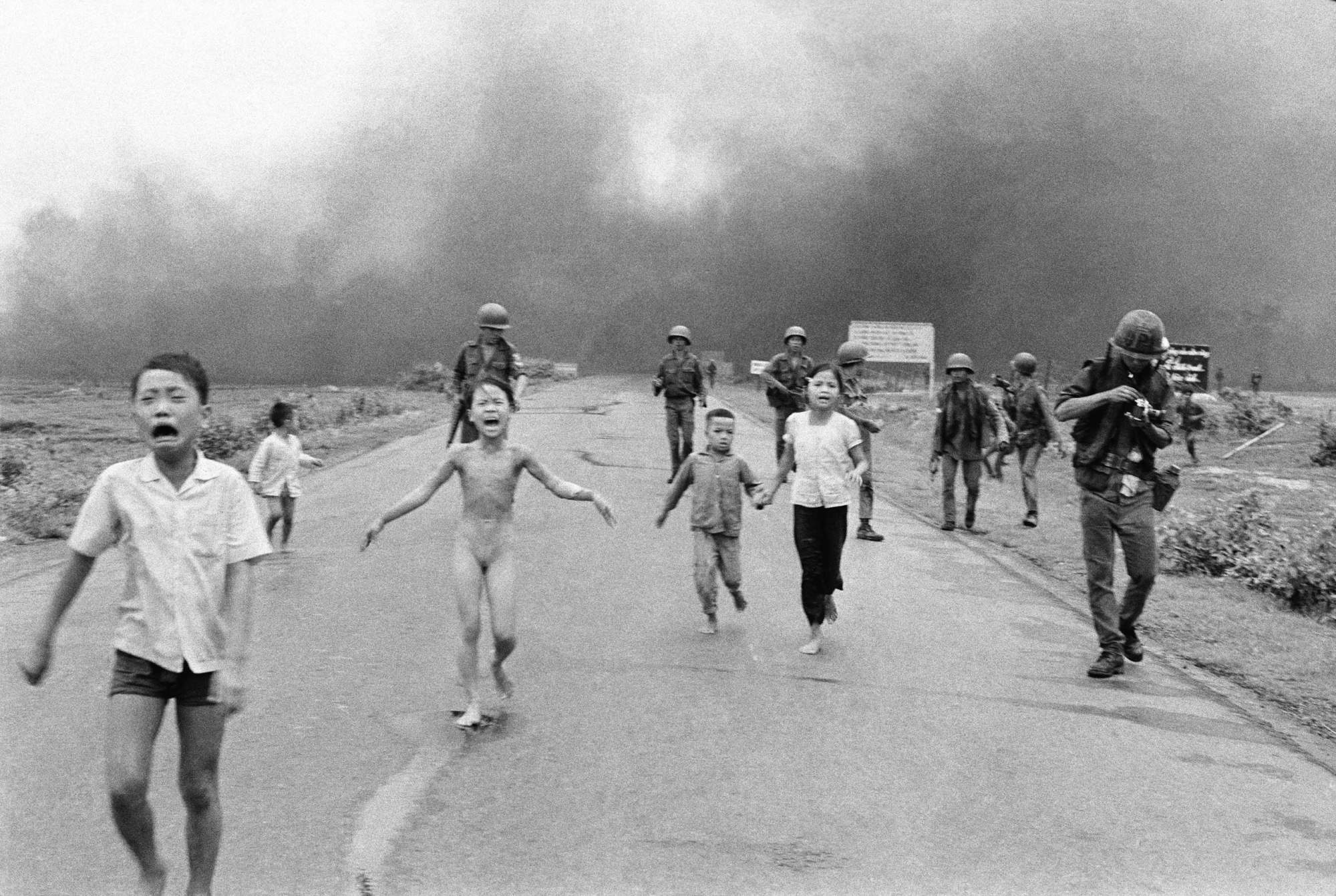

Из-за этого Facebook часто попадает в скандалы. Например, в 2016 году социальная сеть удалила знаменитое фото времен войны во Вьетнаме из-за детской наготы. Тогда Марка Цукерберга обвинили в злоупотреблении властью над соцсетью, но по факту один из едва окончивших школу модераторов не распознал исторический снимок и удалил его из-за поступившей жалобы.

Как жестокий контент влияет на психику модераторов

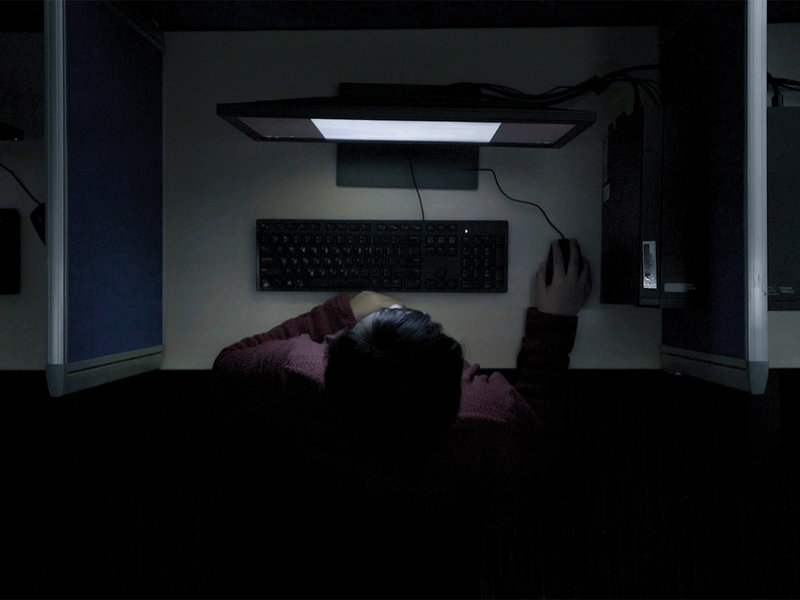

Цифровые чистильщики дорого платят за неправильные вердикты: допустив больше трех ошибок в месяц, они могут потерять работу. Кроме того, погружение в смерть, насилие и детскую порнографию отражается на их психическом состоянии. Один из героев фильма рассказывает о коллеге, который специализировался на тематике самоповреждений, и покончил с собой перед ноутбуком.

«Уровень самоубийств в этой отрасли очень высок. Всякий раз, когда мы общались с модераторами контента, почти все они говорили о случаях, когда кто-то из сотрудников покончил с собой из-за работы. Вот почему было важно включить это в наш фильм. Им нужно нанять психологов, чтобы защитить людей», — говорят режиссеры. Но психологическая поддержка модераторов не является для компании приоритетом.

«Раз в квартал для них проводят сеансы: вся команда собирается в одной комнате, и психолог спрашивает: „У кого-нибудь есть проблемы?“ Конечно, все смотрят в пол и боятся говорить о своих проблемах, поскольку не хотят потерять работу. На кону — их зарплата, которая часто является единственным источником дохода для семьи из 8−10 человек. Нелегко уйти с такой работы», — говорит Ризевик.

Будущее цензуры в социальных сетях

Точное количество модераторов социальных сетей в Филиппинах неизвестно. По словам режиссеров, оно может доходить до 100 тысяч человек. Это большая индустрия, в которой задействованы самые разные люди. И хотя Facebook утверждает, что его руководящие принципы объективны и понятны для всех, в фильме мы видим, что это не так. Культурный фон очень важен в интерпретации спорных изображений.

«Религия — большая часть Филиппин. Идея жертвоприношения имеет решающее значение в их культуре. Она заключается в том, что принесение себя в жертву сделает мир лучше. Таким образом, многие модераторы считают свою работу религиозной миссией. Они используют религию, чтобы придать ей смысл. И это помогает им продержаться немного дольше, — рассказывает Ханс Блок. — На политическом уровне президент Филиппин Дутерте очень силен, и люди в него верят. Почти все модераторы контента, с которыми мы разговаривали, были очень горды, что он победил на выборах. Некоторые люди считают модерацию контента продолжением его работы, поэтому просто удалят то, что им не нравится, в соответствии с политическими взглядами страны».

Всякий раз, когда Facebook попадает в скандалы, касающиеся контента, Марк Цукерберг обещает нанять еще больше людей для обеспечения его безопасности. Но режиссеры «Чистильщиков» убеждены, что низкооплачиваемые филиппинские работники проблему не решат.

«Ему нужно нанять хорошо подготовленных журналистов, — говорит Ризевик. — Facebook — это не просто место, где можно поделиться фотографиями из отпуска или пригласить кого-нибудь на свой день рождения. Это самая крупная коммуникационная инфраструктура в мире. Все больше и больше людей используют Facebook как основной источник информации, поэтому очень важно, кто решает, что будет опубликовано».

Но это стоит больших денег, и не подойдет компании, которая стремится зарабатывать и сокращать расходы. Поэтому чистильщики из Манилы продолжают модерировать контент, который потребляет весь мир.

Документальный фильм также поднимает проблему политической цензуры. Так, в разных частях мира правительства и общество имеют разные представления о том, кто является террористом, а кто — политическим активистом. И хотя Facebook всегда позиционировал себя как политически незаангажированная платформа, Ризевик и Блок показали, что социальная сеть неоднократно блокировала страницы оппозиционеров в Турции, но не сделала ничего, чтобы остановить геноцид мусульман рохгинджа в Мьянме.

Создатели фильма отправляли запросы на интервью представителям Twitter, YouTube и Facebook, но не получили ответа. Компании не захотели оправдываться за использование такого сомнительного аутсорсинга. Тем не менее, об этой проблеме следует знать и говорить вслух, иначе добиться перемен будет очень сложно.

«Facebook очень легко сказать: „Мы не знаем о таких вещах, потому что это не наша компания. Мы не нанимаем их, потому не несем ответственности за условия труда“. Но цена, которую пользователи Facebook платят за чистку социальных сетей — человеческие жизни. И мы должны оказывать давление на эти компании как можно сильнее», — заключает Ханс Блок.

Читайте также: Шпионский триллер: как проводят расследования журналисты «Bellingcat»